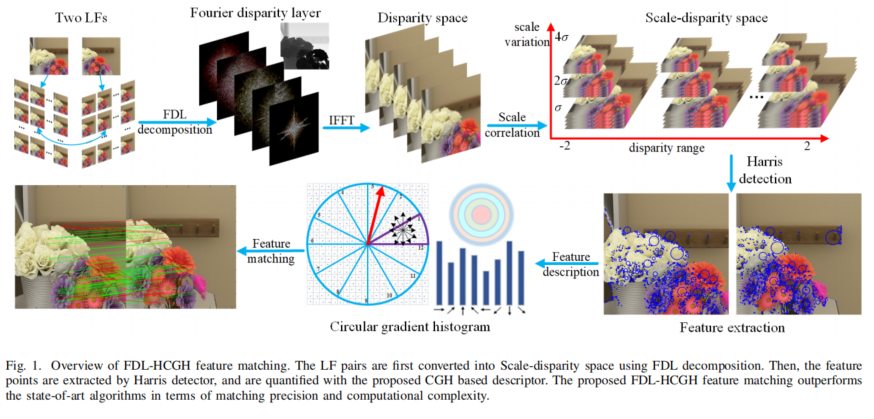

近日,西安理工大学计算机科学与工程学院金海燕教授团队提出了一种新型光场傅里叶视差描述下的圆形邻域特征描述方法,该方法在特征匹配精度与计算效率方面均明显优于现有特征匹配方法(如SIFT、LIFF等)。在此研究中,采用傅里叶频域回归对光场数据进行紧致的分层表示,创新采用圆形邻域构建了对旋转、尺度及深度变化鲁棒的特征描述方法,并优化了方形邻域特征主方向对齐的高计算代价问题。此外,本研究还首次公布了可用于评价光场特征匹配精度的专用数据集。经过大量的对比实验及分析表明,该成果方法是目前光场特征匹配领域精度最优的方法。

光场成像技术作为计算摄影学的代表性技术之一,在场景深度感知能力及数据可计算性方面独具优势。高精度光场特征提取与匹配可服务于计算机视觉领域的众多不同任务,包括场景三维重建、目标检测与跟踪、工业测量等。因此,该研究成果具有较高理论创新性与应用价值。上述研究成果近日在线发表在图像处理领域国际顶级期刊IEEE Transactions on Image Processing(简称IEEE TIP)。第一作者为我校计算机科学与技术学科博士生张萌,通讯作者为肖照林副教授,作者包括张萌、金海燕、肖照林、Christine Guillemot。该成果与法国国立计算机及自动化研究院INRIA合作完成,研究工作得到了国家自然科学基金项目(61871319, 62031023)及欧盟创新研究重点项目(ERC 694122)的资助。金海燕教授团队长期从事图像处理和计算机视觉领域的研究,该项研究成果的取得标志着我校计算机科学与技术学科在该领域研究实力的进一步提升,对促进我校计算机科学与技术学科的国际合作与交流发挥了积极的作用。

论文链接:https://ieeexplore.ieee.org/document/9895181

撰稿:肖照林

审核:李军怀